8기 차진경

우리는 끊임없이 생각한다. 영화를 볼 때, 공부를 할 때, 잠을 잘 때까지 우리는 의식과 무의식의 경계를 넘나들며 생각과 상상의 강에 허우적거린다. 그러한 생각에서 나온 공상이란 참으로 흥미롭고 재미있다. 필자는 어린 시절 과학 상상 그리기 대회 같은 곳에서 자율 주행 자동차, 접혀지는 전자기기, 가정용 로봇 등을 그렸었다. 시간이 흘러 대학생이 된 지금, 비현실적이라고 생각했던 일들이 실현되고 있다. 놀랍고 흥미로운 기술 중 함께 얘기 나누고 싶은 것은 바로 ‘생각을 읽는’ 기술이다.

사람은 소통을 하며 살아간다. 인류는 선사 시대 때부터 현재까지 다양한 방식을 통해 소통해왔다. 간단한 그림을 이용한 의사소통, 언어와 글자를 이용한 소통, 빛과 전파를 이용한 소통 등 다양한 방법이 존재하였다. 시간이 흐름에 따라 그 방식은 발전되었고 편리해졌다. 시간적 제약과 공간적 제약을 넘어선 소통을 위한 기술은 계속하여 개발되고 있다. 이젠 기술의 접근성에 대하여 생각해볼 차례이다.

기술의 발전을 통해 우리는 편리하고 안락한 삶을 제공받지만, 기술의 혜택을 받는 사람들의 폭을 넓히는 것 또한 중요한 목표이다. 기술을 사용할 수 있는 사람의 범위가 넓을수록, 사용한 기술을 통해 공평한 혜택을 받을수록 접근성이 높은 기술이라 할 수 있는 것이다. 그러나 기술의 발전에도 불구하고 사지마비 또는 구어 장애 등의 신경학적 장애를 앓는 사람들은 소통의 방식에서 한계를 느낀다. 과거에 비해 더욱 발전된 소통 방식이 있음에도 불구하고 ‘소통’이라는 행위를 하는 데 있어 소외되는 사람들이 존재한다는 것은 사실이다.

만약 뇌졸중으로 어느 한 순간, 의사소통이 불가능한 상황에 닥치게 된다면 대체 어떻게 의사를 표현할 수 있을까? 주로 환자의 시선을 감지 및 추적하여 표현하는 아이트래킹 기술을 사용하지만, 이는 고속 안구 운동 감지가 허술하다는 어려움이 있다. 그렇다면 안구 운동이나 마비된 사지의 미약한 움직임을 통한 소통이 아닌, 생각만으로 이루어지는 소통은 어떨까? 이것이 바로 생각을 읽는 기술이다.

[1. 생각을 읽는 기술]

생각을 읽는 기술의 핵심은 뇌파이다. 뇌파는 신경계 내 뇌신경 사이에 신호가 전달될 때 생기는 전기적 흐름이며 뇌의 활동 상황을 파악할 수 있는 가장 중요한 지표이다. 따라서 뇌파 신호를 인식함으로써 의사표현이 불편한 환자의 상태를 잘 알 수 있는 것이다.

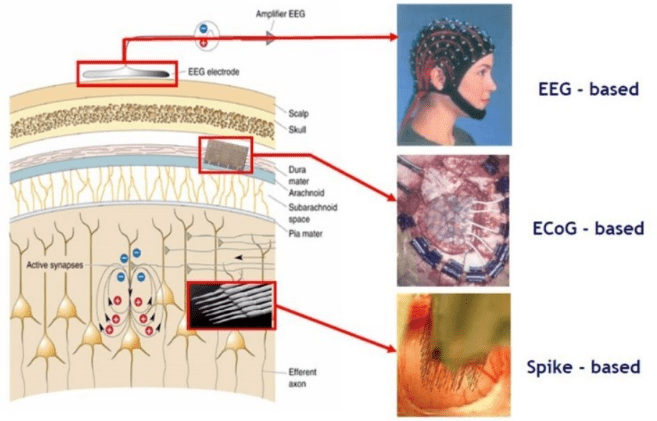

뇌파를 읽는 기술은 다양하다. 흔히 우리가 알고 있는 뇌파 검사는 EEG(electroencephalogram)로, 뇌의 전기적 활동을 파형으로 기록하여 검사하는 방식이다. 이는 비침습적 방법으로 두피에 전극을 부착하여 신호를 측정한다. (부록1) 이때의 뇌파 기록은 두피 근처에 위치한 비슷한 방향을 향하고 있는 대뇌 피질 뉴런 집단에 의해 생성된다. 이렇듯, EEG는 뇌파를 두개골 밖에서 엿듣는 기술이기 때문에 정확도가 떨어진다. 그렇기에 보다 정확하게 뇌파를 분석하기 위해선 전극을 뇌 피질에 직접 붙이는 방식이 효과적이다.

뇌 피질에 직접 전극을 부착하는 방식은 ‘침습적인’ 방법이다. 침습적인 방법은 수술을 필요로 하며, 일반적으로 환자 치료나 원숭이 실험에서 사용된다. 뇌로부터 발생하는 신호를 ‘직접’ 측정하는 방법이기 때문에 앞서 언급한 비침습적인 방법에 비해 더 정확하게 신호 측정이 가능하다는 장점이 있다.

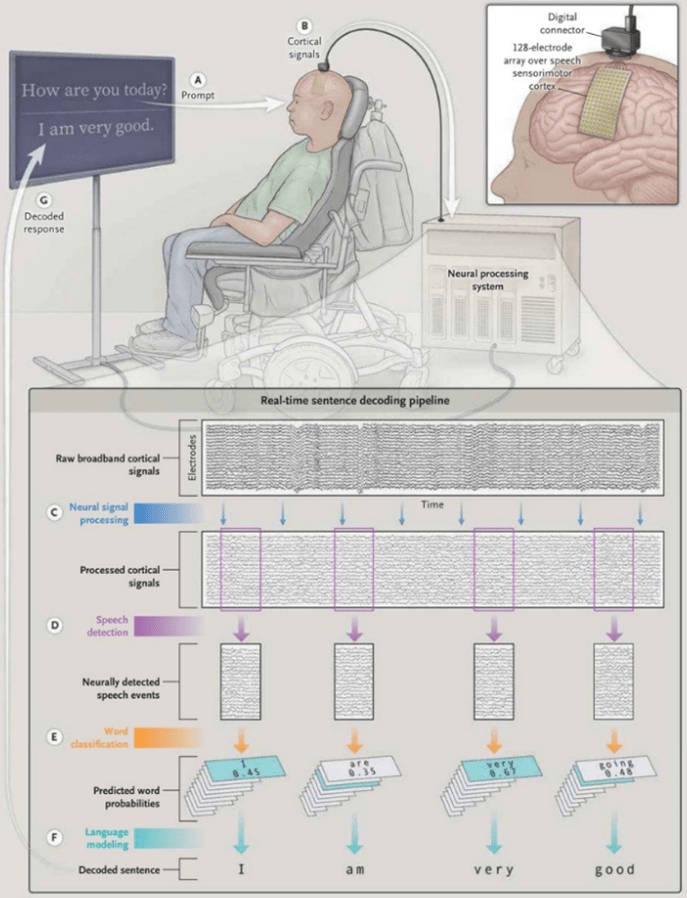

올해 발표된 연구에서 [1]뇌파를 이용한 생각의 표현이 가능하다는 것이 알려졌다. 뇌졸중으로 인해 사지가 마비된 36세의 남성 환자를 대상으로 실험을 진행하였고, 실험 내용은 뇌파를 분석하여 모니터에 문장을 완성시키는 실험이었다. 실험은 크게 뇌 신호 처리, 발화 감지, 단어 분류, 언어모델링 등의 과정을 거친다. 좀 더 구체적으로 살펴보자.

1) 환자의 감각운동겉질([i]sensorimotor cortex)에 전극을 침습적인 방법으로 부착한다.

2) 부착한 전극을 통해 얻은 가공하지 않은 뇌파 신호를 실시간으로 처리하여 가공한다.

3) 가공된 신호를 언어 감지 모델을 이용하여 분석한다.

4) 그렇게 걸러진 신경 신호를 단어 분류 알고리즘을 이용하여 각각의 단어로 해석한다.

5) 자연어 처리 모델(natural language model)을 통해 단어 사이 개연성을 계산한다.

6) 생각한 문장이 모니터에 나타난다.

위와 같은 과정을 한 번의 실험만으로 좋은 결과를 얻는 것은 어렵기 때문에, 사용자가 기술에 익숙해지도록 반복 훈련하였다. 그리하여 8주 동안 총 50번의 트레이닝을 거치도록 실험을 진행하였다. 훈련이 끝난 후, 심각한 뇌졸중 후 끙끙거리는 소리나 신음 소리만 낼 수 있었던 피험자는 실험 끝에 분당 약 15개의 단어를 만드는 속도로 디스플레이 위에 문장을 만들어낼 수 있었다. 디스플레이에 표현된 문장의 정확도는 약 75% 수준이었으며 오류 빈도 또한 낮은 것으로 판단되었다.

놀랍지 않은가? 마치 판타지 영화 속 초능력을 통해 텔레파시를 하는 것처럼 이렇게 단지 ‘생각’ 함으로써 나의 의사를 표현할 수 있게 된 것이다! 현재 이 기술은 메타(Meta)[ii]에서 개발하고 있으며 메타뿐만 아니라 다양한 SNS 기업에서 뇌파 및 신경 신호를 이용한 소통 기술에 집중하고 있다.

[2. 생각으로 조종하는 기술]

그렇다면 더 나아가 생각을 통해 의사를 표현하는 것을 넘어서 무언가를 ‘조종’하는 것은 가능한 일일까?

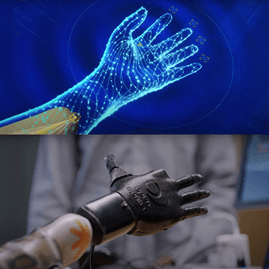

가능하다. 단지 생각하는 것만으로 기계를 움직이고 컴퓨터를 조작하며 다른 사람을 조종할 수 있다. 공상 과학 영화에 나오는 먼 미래의 얘기 같으나 현실 세계에서 끊임없이 연구되고 있다. 미국 고등국방연구소(DARPA) 연구에서 사지마비 환자에게 전극을 이식하여 로봇 팔을 조종하게 만든 사례가 존재한다. 조금 더 상상의 폭을 넓혀보자. 로봇팔 조종을 뛰어넘어 과연 생각만으로 어디까지, 어떤 것까지 생각만으로 조종할 수 있을까?

앞서 설명한 로봇 팔 조종 기술을 이용하여 오직 생각만으로 ‘경비행기’를 조종할 수 있다. 이는 조종 경험 유무, 조종 관련 지식이나 자격증 유무와 상관없이 가능하다! 디스플레이에 뜨는 상승, 하강, 오른쪽, 왼쪽의 화살표에 집중하면 그에 따른 뇌파를 분석하여 실제 비행기의 이동 경로로 나타나는 것이다.

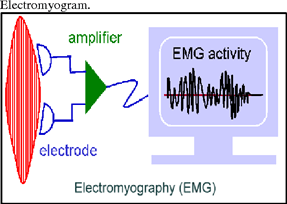

위와 같은 조종 사례와 비슷한 경우로, 생각을 읽는 것은 아니지만 근육 주위 신경 신호를 읽음으로써 충분히 무언가를 조종할 수도 있다. 예를 들어, 인공 신체를 조종하는 경우가 있다. 신체 결손으로 인해 인공 팔을 부착하였을 때, 가장 구현하기 어려운 것은 손가락의 움직임이다. 엄지와 나머지 네 손가락의 분류는 그나마 가능하지만, 네 손가락의 움직임을 하나의 덩어리로 간주해버리는 경우가 많기 때문이다. 그러나 최근 각각의 손가락의 자유로운 움직임이 가능한 인공 팔이 개발되었다. 손가락은 없으나 신체에 손가락과 연결되었던 근육 및 신경은 남아 있기 때문에 실제로는 없는, 상상 속 손가락을 움직일 때 만들어지는 신호를 초음파로 분석할 수 있다. 분석한 신호를 바탕으로 엄지, 검지, 중지, 약지, 새끼 이 다섯 가지 손가락을 각각 표현하게 된다.

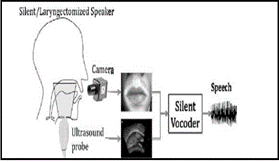

또 다른 한 가지 경우는 성대 근육 신호를 분석하는 경우가 있다. DARPA에서 연구한 Silent Talk 이라는 프로젝트는 말을 하려 할 때 성대, 아랫턱 등에 신호를 보내기 전 생성되는 특정 패턴의 뇌파를 분석하여 사람이 어떤 말을 할 지 파악하는 기술이다.

실제 입모양의 움직임을 파악하기 위한 카메라와 성대 근육 신호를 이용하여 직접 음성 신호를 입 밖에 내지 않아도 소통하는 것이 가능해지는 것이다.

그러나 여기서 의문점이 생긴다. 태어날 때부터 언어 장애를 가진 사람은 성대 근육 신호 만으로 음성 정보 전달이 가능할까? 농인은 ‘말하지 못하는 사람’이 아니다. 청각 장애를 가지고 있어 청각적인 언어 자극을 받지 못한 사람일 뿐이다. 소리가 들리지 않기 때문에, 농인은 자신의 발음을 직접 듣고 다른 사람의 발음과 비교하며 교정하는 과정을 거치지 못한다. 그래서 목소리는 나지만 음절의 분화를 파악하기 어렵고 특정 발음이 어려운 경우가 많다.

다시 질문으로 돌아오자면, 이렇게 성대 신호가 비장애인과 비교하였을 때 불분명한 사람들을 대상으로 이런 기술을 적용할 수 있을까? 기술을 사용하기 위해선 input의 정확도가 중요한 만큼, 불분명한 신호를 바탕으로 좋은 결과가 나올 수는 없다고 생각한다. 이와 관련하여 연구 사례를 찾아보려 하였으나, 언어 장애인을 성대 신호 관련 실험 대상으로 진행한 연구 사례가 잘 찾아지지 않았다. 그러나 이후 시간이 흘러, 기술 발전과 더불어 발화 장애인들의 성대 데이터셋이나 성대 근육 신호 및 뇌파와 관련하여 더 정확하게 파악한다면 이 조차도 허무맹랑한 소리가 아닐 것이다. ‘지금’ 당장은 불가능하겠지만, 이 글을 읽고 있는 독자 여러분, 미래의 뉴러너들에게 한 번 기대해 보고 싶다.

[3. 뇌파로 감정 읽기]

계속해서 질문의 폭을 늘려보자. 뇌파를 이용하여 생각을 읽을 수 있다면, 뇌파를 통해 감정을 파악할 순 없을까? 이러한 질문에 관련하여 오랫동안 끊임없이 연구되어 왔다. 뇌파를 이용한 감정 읽기란 앞서 예시로 든 소통의 경우와 비교하였을 때 더 어렵다고 말할 수 있다. 이는 감정의 기전이 완벽히 밝혀지지 않았기 때문이다. 우리가 평소에 행복감, 슬픔, 안타까움 등등 여러 단어로 표현하는 현재 이 상태, 이 감정은 단순히 특정 신경 신호로 인해서, 또는 호르몬에 의해서 설명되지 않는다.

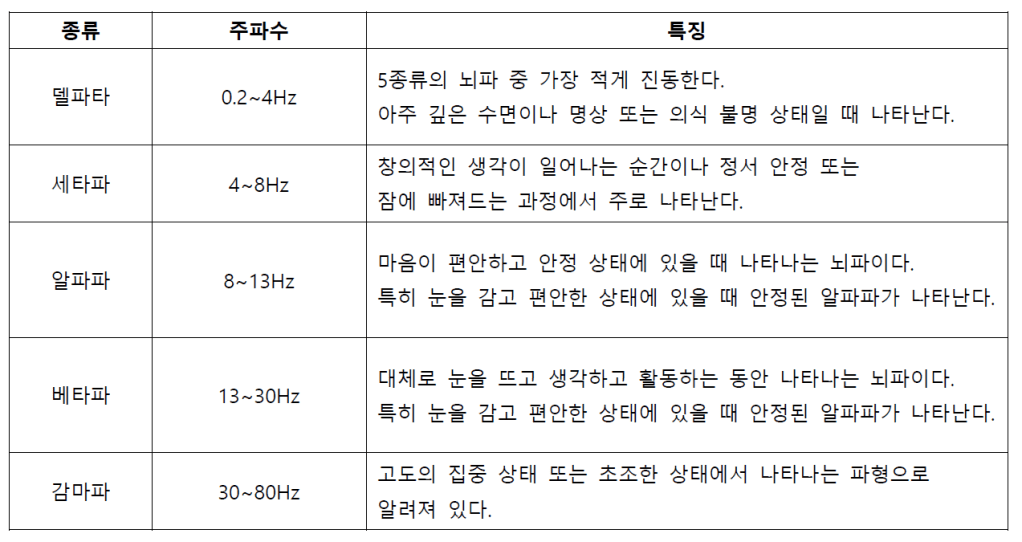

그렇기에 현재 연구된 내용에 따르면 복합적인 감정보다는 스트레스, 불쾌감, 공포 등의 감정을 파악하는 것이 쉽다는 것을 알 수 있다. 이러한 뇌파를 통한 감정 파악을 사용하는 분야 중 하나가 바로 ‘신경건축학’이다. 독자 여러분 중 대부분이 천장이 높은 곳에 들어갔을 때 개방감을 느낀다거나 벽지 색에 따라서 영향을 받는 등의 경험을 해본 적이 있을 것이라고 생각한다. 신경건축학은 공간에 대한 사람의 기분과 생각을 뇌파와 같은 감각신호를 통해 측정한 뒤, 이를 바탕으로 최적의 공간을 제공하는 것을 목표로 하는 학문이다. 기존 건축은 경험적인 지식에 의존하거나 사용자의 요구사항에 맞추어서 공간을 설계하였지만, 간편하게 착용 가능한 EEG 측정 장비를 이용하여 건축 분야에서도 뇌파를 사용하는 시도가 많아졌다. VR 기기를 사용하여 가상 공간을 체험할 때도 EEG로 감정 측정이 가능하다. 이를 테면 심신이 안정된 상태에서는 α파가 많이 나오고, 긴장을 하거나 불안할 경우에는 β파가 많이 발생한다(부록1). 이러한 뇌파 감지를 통해 공간에 대한 사용자의 감정 또한 파악이 가능한 것이다. 아직은 간단한 감정, 기분만 감지가 가능하고 그조차 정확하지는 않지만 감정의 기전에 대해 밝혀지고 뇌파 정보의 정확도가 올라가면 우리가 자주 느끼는 다른 감정들도 읽을 수 있을 것이다.

[마무리]

막연한 상상이 현실로 다가오는 순간이 빈번해졌다. 어렸을 때 판타지 영화 속에서만 보던 장면이 앞으로 계속하여 눈앞에 펼쳐질 것이다. 물론, 지금 당장 뇌파를 이용한 기술의 상용화를 기대하는 것은 힘들겠으나 가능성이 보인다는 것만으로도 큰 한걸음을 내딛었다고 생각한다. 그러나 명심해야 할 점이 있다. 연구를 통해 이러한 가능성을 제시하고 새로운 실험 결과를 보여주는 것에서 멈추는 것이 아니라 어디에 쓰일 수 있는지, 또 어떻게 쓰일 수 있는지 끊임없이 고민해야 한다는 것이다. 기술의 혜택을 받는 사람이 없다면 그 기술의 발견이 의미가 있다고 할 수 있을까? 결국 중요한 것은 발견에서 그치는 것이 아닌, 기술의 상용화이다. 학자들은 기술의 발견에서 어떤 게 부족한지 한계를 파악하고 다시 피드백함으써 기술을 개발해야 한다. 다시 뇌파 기술로 돌아와 한계와 관련해서 얘기를 하자면, 뇌파 관련 기술은 뇌파 신호 인식의 정확도와 관련해서 끊임없이 개선해야 한다.

예컨대, 비침습적인 방식과 침습적인 방식 중 정확도가 높은 것은 후자이다. 만약 당신에게 ‘기술을 사용하고 싶으시다고요? 그럼 두개골에 100원짜리 크기의 구멍을 뚫어야 하는데, 하시겠어요?’ 라고 말한다면 선뜻 할 의지가 생기지 않을 것이다. 그렇기에 기술의 상용화를 위해서는 비침습적인 방식으로도 높은 정확도를 가지며 뇌파 신호를 파악해야 할 것이다.

BCI 기술에 관하여 최근 흥미를 갖기 시작한 필자는 이 글을 통해 ‘뇌파’를 이용한 기술의 가능성을 언급하고 싶었다. 뇌파를 통해 생각만으로 의사표현이 가능하고, 내 몸이 아닌 무언가를 조종하는 게 가능해지며, 감정이라는 복잡한 상태를 파악할 수 있다. 글의 첫 부분에서도 말했듯이, 뇌파를 이용한 이러한 기술은 사용 대상자의 범위를 훨씬 넓힐 수 있다. 장애인과 비장애인의 삶의 질 격차를 줄일 수 있을 것이고 두 집단 사이의 소통의 한계를 뛰어넘을 수 있을 것이라 예상한다. 멀지 않은 미래 모두가 자유롭게 소통하는 세상이 오길 바란다.

[부록]

부록1. EEG를 이용한 뇌파의 분류

두피 근처에 위치한 전극이 비슷한 방향으로 향하고 있는 대뇌 피질 뉴런 집단의 전류의 흐름을 파악하여 뇌파가 기록된다. 뇌파는 크게 나누어진다. 자극이 주어졌을 때 나타나는 뇌파와 외부 자극이 없이 나타나는 뇌파 총 두 종류이다. 외부 자극 없이 나타나는 뇌파에는 다시 여러 종류가 있다. 뇌파의 주파수에 따라 나누어지며, 델타파, 세타파, 알파파, 베타파, 감마파 5종류가 존재한다.

[1] Moses, D. A., Metzger, S. L., Liu, J. R., Anumanchipalli, G. K., Makin, J. G., Sun, P. F., … & Chang, E. F. (2021). Neuroprosthesis for decoding speech in a paralyzed person with anarthria. New England Journal of Medicine, 385(3), 217-227.

[2] Moses, D. A., Metzger, S. L., Liu, J. R., Anumanchipalli, G. K., Makin, J. G., Sun, P. F., … & Chang, E. F. (2021). Neuroprosthesis for decoding speech in a paralyzed person with anarthria. New England Journal of Medicine, 385(3), 220.

[3] Deepak Balwani et al. “Talking Without Talking”. Journal of Engineering Research and Applications Vol.4(2014). P.22.

[4] Youtube. (2019.12.19). The Age of A.I. : How far is too far?[Video file]. Retrieved from https://www.youtube.com/watch?v=UwsrzCVZAb8

[5] Deepak Balwani et al. “Talking Without Talking”. Journal of Engineering Research and Applications Vol.4(2014). P.23.

[i] 뇌 피질 중 움직임을 조절하고 감각의 분별 및 인식을 담당하는 겉질이다.

[ii] 최근 페이스북 기업이 회사명을 메타(Meta)로 변경하였다.

댓글 남기기